- DeepSeek一体机

- 搭载NVIDIA GPU算力卡

- 搭载国产GPU算力卡

- 专有网络VPC

- 通过专线/VPN/GRE等方式构建混合云网络

- 负载均衡SLB

- 对多台服务器进行流量分发,消除单点故障

- 物联网无线连接

- 物联网卡,如:车联网、智能家居等

- SD-WAN服务

- 数据中心之间互联DCI

- 企业上云专线

- 跨国企业组网

- 免费试用

- 大数据解决方案

- 个性化推荐解决方案

- 大数据仓库解决方案

- 数字营销解决方案

- 企业数据服务解决方案

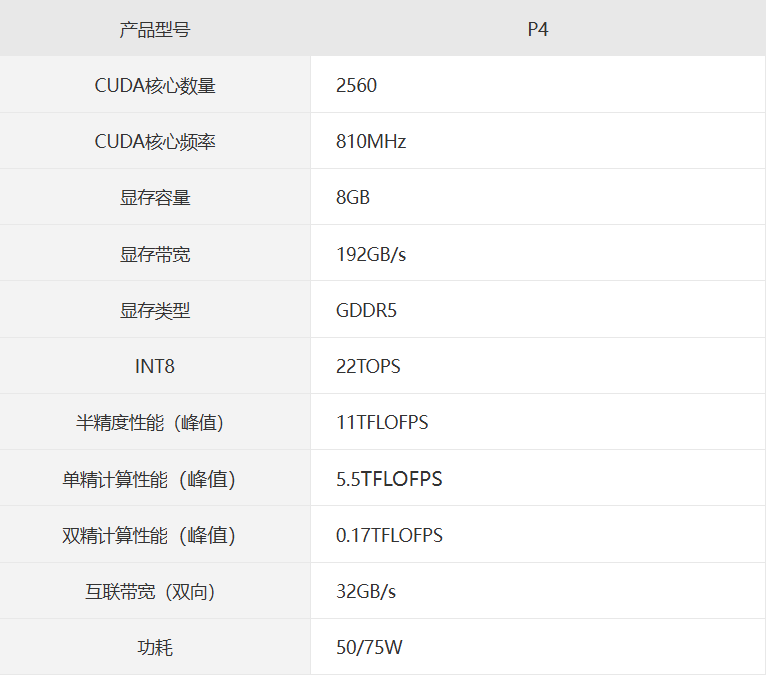

通过实时推理提供快速响应的用户体验

响应速度是决定用户是否使用互动语音、视觉 搜索和视频推荐等服务的关键因素。随着模型的 准确性和复杂性越来越高,CPU 已经无法再提供 响应灵敏的用户体验。Tesla P4 借助 INT8 运算 能力提供高达 22 TOPS 的推理性能,可将延迟 降低 15 倍。

为低功耗扩展型服务器带来更高效率

Tesla P4 凭借小巧的外形和 75W 的功耗为经过 密度优化的扩展型服务器加速。该加速卡还可为 深度学习推理工作负载提供比 CPU 高 60 倍的 惊人能效,满足超大规模客户对 AI 应用程序 飞速增长的需求。

借助专用解码引擎开发新的 AI 型视频服务

Tesla P4 配备专用的硬件加速解码引擎,能对多达 35 路高清视频流进行实时转码和推理,该解码 引擎可与进行推理的 GPU 并行运作。将深度学习 集成到视频流水线后,客户可以向用户提供之前 无法实现的智能创新型视频服务。

使用 TENSORRT 和 DEEPSTREAM SDK 加快 部署速度

TensorRT 是为优化部署到生产环境的深度 学习模型而创建的库。它通常以 32 位或 16 位 数据的形式获取接受训练的神经网络,并针对 降低精度的 INT8 运算能力优化这些网络。 NVIDIA DeepStream SDK 利用 Pascal GPU 的 强大功能,可以同时解码和分析视频流。

中国互联网信息中心(CNNIC)IP地址分配联盟成员 北京市通信行业协会会员单位 中国互联网协会会员单位

跨地区增值业务经营许可证(B1-20150255) 电信与信息服务业务经营许可证(京ICP证060342号) 京ICP备05032038号-1 京公网安备11010802020193号

Copyright ?2005-2024 北京互联互通科技有限公司 版权所有